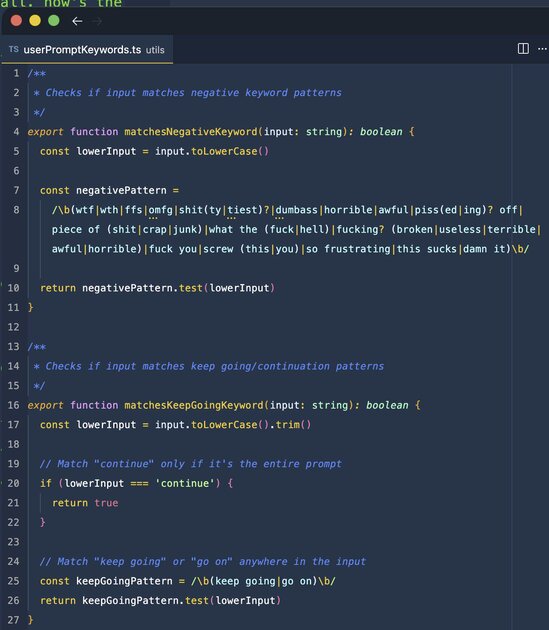

Вчера, 31 марта, пользователь под ником Chaofan Shou обнаружил в реестре npm-пакетов весь исходный код CLI-инструмента для программирования Claude Code от компании Anthropic. Естественно, энтузиаст выложил ZIP-архив со всеми полученными им файлами, который вскоре разлетелся по интернету. И в процессе изучения исходного кода пользователи выяснили некоторые весьма интересные детали — например, в файле userPromptKeywords.ts программисты обнаружили переменную под названием negativePattern, в которой прописаны многочисленные матерные слова на английском языке.

Кроме того, над этой переменной имеется комментарий:

«Проверь, соответствует ли инпут шаблонам отрицательных ключевых слов».

К сожалению, исходный код Claude Code пока что не дал ответ на вопрос о том, зачем система регистрирует матерные слова, которые вводит пользователь, а представители Anthropic пока что ситуацию не комментируют. Но пользователи из сети предположили, что, вероятно, искусственный интеллект сканирует текстовые промпты пользователя в диалоге, отслеживая матерные слова и негативный эмоциональный тон сообщений. И когда система регистрирует совпадение, опять же, скорее всего, искусственный интеллект будет пытаться подойти к решению задачи иначе, либо же повысить точность предоставляемых ответов.

Условно говоря, если у программиста возникла ошибка с кодом, который отказывается работать, а Claude Code в течение нескольких итераций не может понять вопрос или решить эту проблему, пользователь начинает писать более гневные промпты, высказывая своё недовольство. Тогда система «понимает», что её поведение не устраивает юзера, и применяет другие паттерны, инструменты или даже большие языковые модели. Безусловно, всё это можно было бы отслеживать специальными алгоритмами, и они, вероятно, тоже принимают участие в процессе анализа, но регистрация ключевых слов — гораздо более дешёвый способ изменять эмоциональное состояние пользователя, чем создание отдельной LLM.