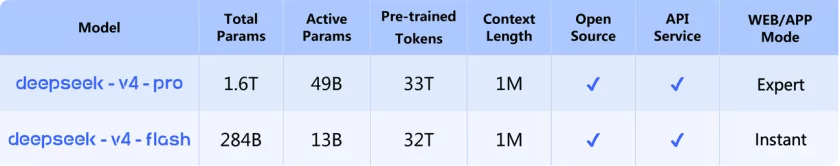

Китайский стартап DeepSeek выпустил новую версию языковой модели DeepSeek V4 с открытым исходным кодом. Разработчики позиционируют её как экономичное решение, способное обрабатывать запросы с контекстным окном до 1 миллиона токенов. Текущая линейка включает две версии модели: DeepSeek V4 Pro и DeepSeek V4 Flash, обе доступны на сайте DeepSeek в режиме глубокого мышления и в быстром режиме. API также был обновлен и уже доступен.

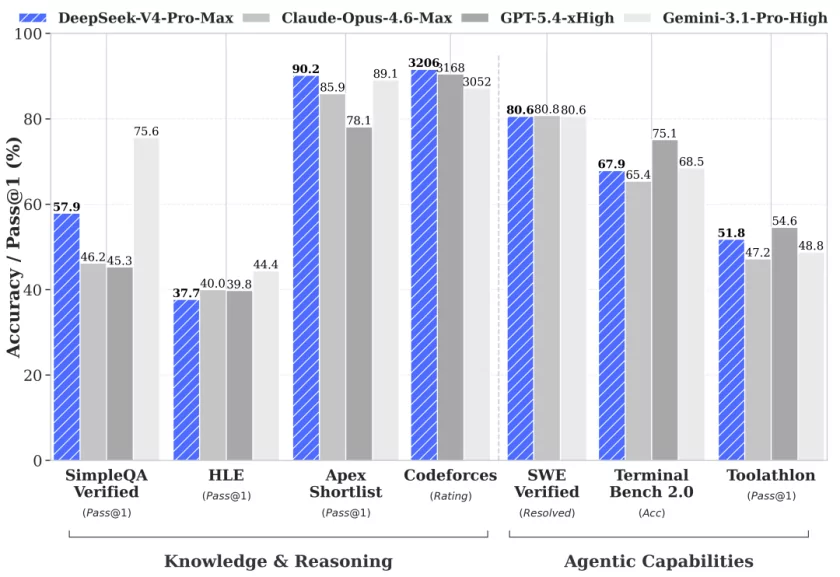

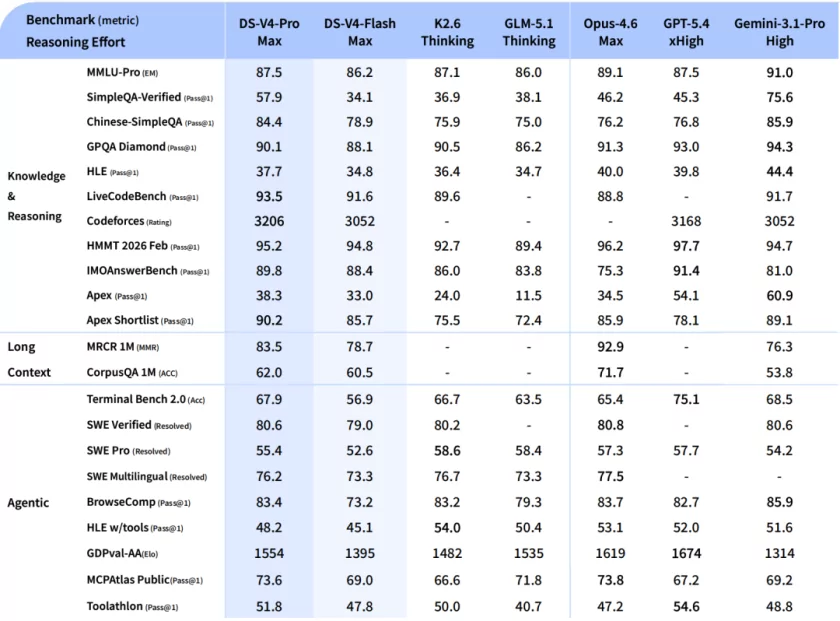

DeepSeek V4 Pro имеет 1,6 трлн общих параметров, из которых 49 млрд активных, а DeepSeek V4 Flash — 284 млрд общих параметров, из которых 13 млрд активных. По словам разработчиков, версия Pro обладает расширенными возможностями управления ИИ-агентами, обширными знаниями об окружающем мире (уступает в этом только закрытой Gemini 3.1 Pro), превосходит все существующие открытые модели в математике, STEM-дисциплинах, программировании и конкурирует с лучшими моделями с закрытым исходным кодом. В тесте популярного бенчмарка MMLU-Pro для оценки кодирования DeepSeek V4 Pro показала результаты, сопоставимые с GPT-5.4, немного уступая Gemini 3.1 Pro и Claude Opus 4.6.

DeepSeek V4 Flash предоставляет возможности логического мышления, которые близки к версии Pro. Эта модель демонстрирует сопоставимую производительность при выполнении простых агентских задач, но при этом более экономичная при использовании через API.

Что касается стоимости использования моделей через API, то входные данные V4 Flash обходятся всего в 0,028 доллара, а выходные — в 0,28 доллара. Для модели V4 Pro цены соответственно составляют 0,145 и 3,48 долларов. Разработчики могут использовать их с популярными инструментами для агентов, такими как Claude Code и OpenClaw. Обычным пользователям модели DeepSeek V4 доступны бесплатно через чат-бота.