Сегодня, 5 августа, разработчики из компании Яндекс официально представили в своём фирменном браузере уникальную в своём роде технологию, которая позволяет в автоматическом режиме реализовывать закадровый перевод прямых трансляций на YouTube. Благодаря этому презентации долгожданных новинок рынка электроники, различные интервью со знаменитостями Голливуда и напряжённые онлайн-трансляции запуска ракет в космос будут доступны в том числе и на русском языке в режиме реального времени. Правда, разработчики сразу отметили, что сейчас технология представлена в режиме открытого бета-тестирования, так что перевод трансляций доступен только на YouTube-каналах из конкретного плейлиста на платформе.

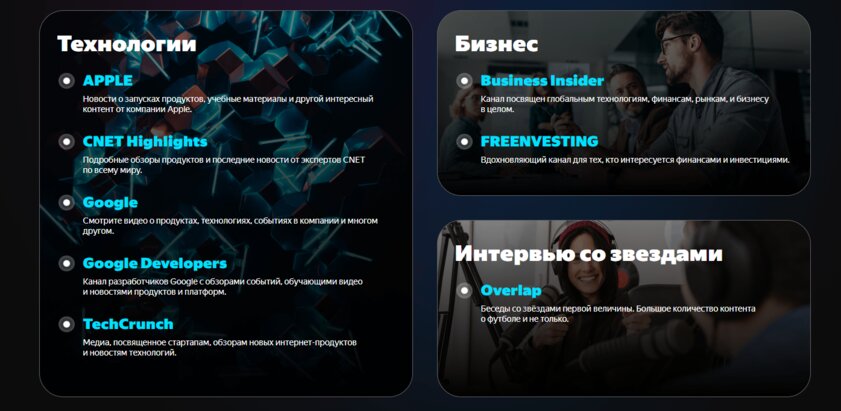

Преимущество данной функции в том, что пользователю, который интересуется высокими технологиями и прочим увлекательным контентом, не придётся долго ждать, пока нужное ему видео появится с переводом в формате записи по завершению мероприятия. Теперь стримы можно смотреть на русском языке сразу в процессе проведения трансляции — это касается вебинаров, бизнес-конференций или крупных событий от титанов рынка цифровых технологий — к примеру, можно будет посмотреть презентацию Apple с переводом в режиме реального времени. И, видимо, на этом в Яндексе останавливаться не планируют.

«Мы продолжаем совершенствовать технологии, которые помогают стирать языковые границы в интернете. Следующий шаг — перевод потоковых трансляций и видеороликов не только на YouTube, но и, например, в Twitch», — Заявил Дмитрий Тимко, руководитель приложения Яндекс и Яндекс Браузера.

При этом стоит отметить, что закадровый перевод прямой трансляции — очень сложная инженерная задача, так как для качественного перевода речи на иностранном языке крайне важен контекст, ведь в разных сценариях одни и те же слова могут иметь разное значение. Соответственно, для правильного перевода нейросети нужно отдать как можно больше текста за одну «порцию». Но когда речь идёт о потоковом вещании, пользователю важна минимальная задержка перевода, а значит, делать это нужно моментально — просто нет времени ждать, пока спикер полностью сформулирует свою мысль. Нейросеть должна выступать синхронным переводчиком, который начинает переводить предложение ещё до того, как его произнесли до конца.

Для того, чтобы реализовать быстрый и качественный перевод трансляций в реальном времени, разработчикам компании пришлось полностью перестроить архитектуру технологии закадрового перевода видеороликов. Дело в том, что в случае с переводом записанного контента нейросеть получает всю аудиодорожку и, соответственно, полный контекст предложения — это облегчает задачу. Механизм работы с трансляциями сильно отличается — одна нейросеть распознаёт аудио и превращает контент в текст на лету, тогда как другая определяет пол спикера по его биометрии. На следующем самом сложном этапе третья нейросеть расставляет в тексте знаки препинания и выделяет из всего текста смысловые фрагменты — те элементы, которые содержат законченную мысль. И уже их забирает четвёртая нейросеть, которая отвечает за перевод — он сразу же синтезируется на русском языке.

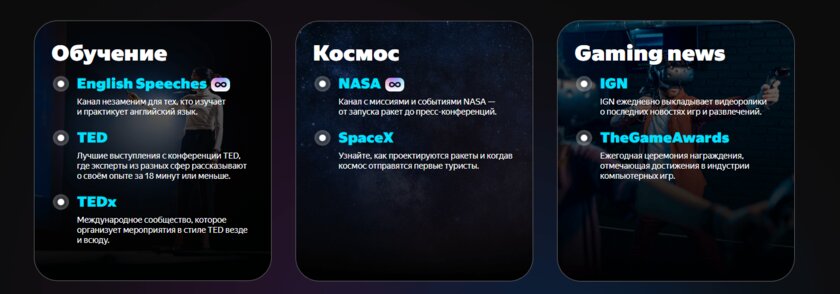

Оценить возможности технологии уже сейчас может любой желающий — для этого нужен Яндекс Браузер на ПК.